아마존 알렉사 인공지능 AI 스피커 수화 인식한다

- IT 잡학세상

- 2022. 7. 6. 02:07

인공지능 AI 스피커가 확산되고 있습니다. 그 중 수화를 이해할 수 있는 인공지능 비서가 있으면 어떨까요?

하지만 청각 장애인에게 이러한 음성에 의존하는 기기가 발전하여도 사용하기가 힘들죠. 음성인식은 청각 장애인 사용자의 리듬을 인식하기 어렵고, 음성 보조 장치와의 의사소통에도 어려움이 있습니다.

수화 인식 AI 스피커

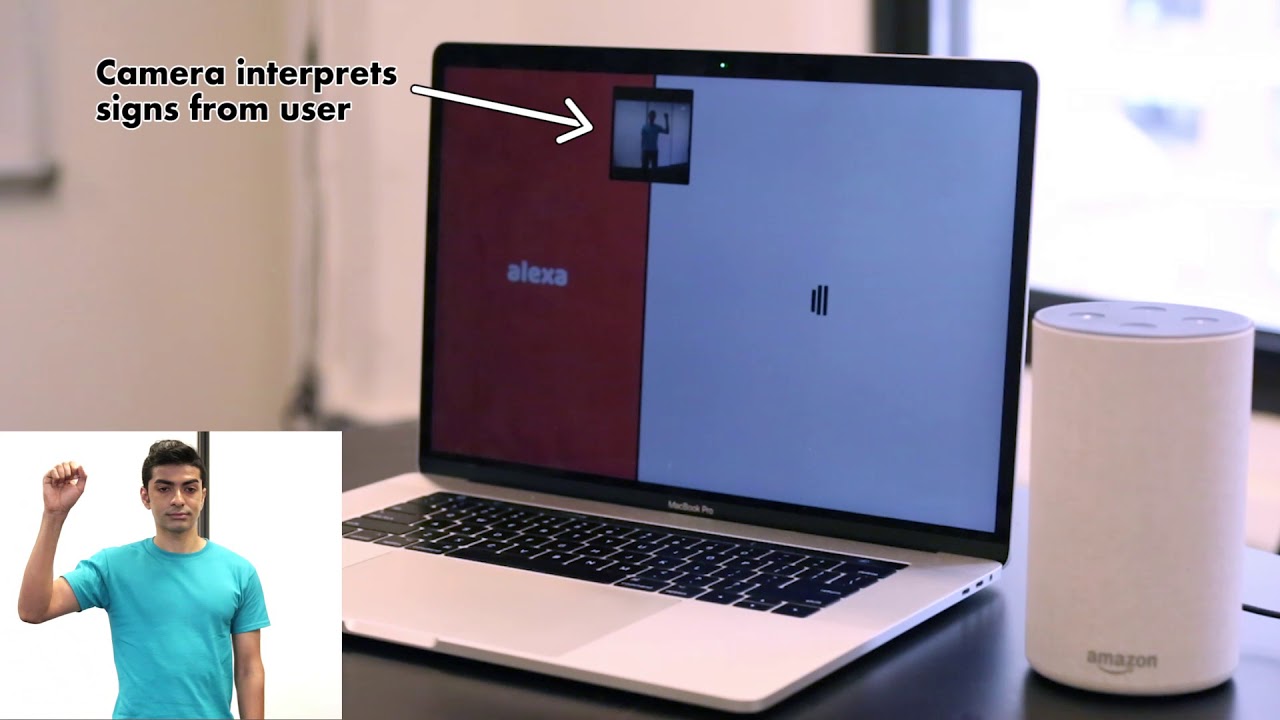

아직 정식 출시 전인지만 최근 소프트웨어 개발자 아비쉑 싱은 아마존 AI 알렉사를 통해 간단한 수화 동작을 해석하는 시스템을 개발했다고 합니다. 사용자가 몇 가지 기본적 수화를 하면 노트북에 설치된 알렉사가 웹 캠으로 시각 신호를 분석해서 텍스트로 번역합니다. 사용자가 미국식 수화(ASL)를 하면 알렉사가 이를 텍스트로 인식하고 음성과 함께 텍스트로도 답변하는 서비스를 제공합니다.

구글의 AI 오픈 프로그램 텐서플로(TensorFlow)를 활용해 이러한 시스템을 만들었다. 텐서플로는 AI의 기계 학습 응용 프로그램을 코딩해 웹 브라우저에서 이가 실행되는 것을 돕습니다.

사용자가 수화 언어를 사용하면 구글의 텍스트 음성 변환 소프트웨어가 수화 언어를 텍스트로 전환, 해당 단어를 음성으로 변환하죠.

그리고 아마존 에코(Amazon Echo)가 이에 반응하고 알렉사의 음성 반응은 자동으로 컴퓨터에 의해 텍스트로 변환되어 사용자는 이를 읽을 수 있게 됩니다. 즉, 노트북을 사용자와 알렉사 사이의 통역사가 되는 겁니다.

싱은 음성 인식 비서들에게서 영감을 얻었다며 “집과 직장 생활에서 음성 인식 장치들이 기본 바탕이 될수록 듣지 못하고 말하지 못하는 사람들을 위한 기술을 누군가는 생각해야 한다”고 전했습니다.

싱은 구글의 AI 오픈 프로그램 텐서플로(TensorFlow)를 활용해 이러한 시스템을 만들었다고 합니다.. 텐서플로는 AI의 기계 학습 응용 프로그램을 코딩해 웹 브라우저에서 이가 실행되는 것을 도와줍니다.

싱이 공개한 튜토리얼 영상만 봐도 수화 인식은 기술적으로 충분히 가능한 것임을 알 수 있습니다. 그는 “(수화 인식 기능은) 이 기술이 궁극적으로 활용돼야 하는 부분이라고 생각한다”고 거듭 강조했습니다.

또한 개발한 프로그램 오픈소스화하고 다양한 사용자들이 자발적으로 참여해 어휘 범위를 넓힐 수 있다고 이야기했습니다. 이 또한 아마존의 AI 오픈플랫폼의 하나가 될거 같습니다.

수화 인식 미래

수화 번역을 위해 인공지능과 영상인식 기능을 이용하려는 시도는 이번이 처음이 아닙니다.

마이크로소프트는 수화 번역을 실험하기 위해 동작 감지 키넥트(Kinect)카메라를 이용했지만, 키넥트가 2017년 중단되면서 이 프로젝트 또한 서서히 중단됐습니다. 저도 학부시절에 키넥트를 통해 프로젝트를 진행했지만 정확한 동작인식이 필요할 때는 사용하기가 쉽지 않았습니다.

그렇기에 수화를 자동으로 텍스트나 음성으로 번역하는 방법은 여전히 어렵다고 합니다. 하지만 싱의 이러한 시도를 통해 청각장애인을 위한 언어 접근을 창의적인 해결방안을 통해 성공한다면 많은 의미가 있다고 생각합니다.

'IT 잡학세상' 카테고리의 다른 글

| 밀리의 서재 전자책 보실 때 추천 (0) | 2022.07.21 |

|---|---|

| 오토드로우(Auto Draw) 사용 인공지능 그림 그리기 (0) | 2022.07.13 |

| 구글 트렌드 활용 빅데이터 분석하기 (0) | 2022.07.06 |

| 이쁜 무료 이미지 다운로드 사이트 소개 (0) | 2022.06.07 |

| 영어 문법 검사를 한번에 하자!, GINGER (0) | 2022.06.07 |

이 글을 공유하기